Quando le macchine sembrano morali

La competenza morale

Nel febbraio 2026, la prestigiosa rivista Nature ha pubblicato uno studio che potrebbe segnare un punto di svolta nel nostro rapporto con l’intelligenza artificiale. Un team di ricercatori delle più importanti istituzioni accademiche e industriali – tra cui Google DeepMind, Stanford e MIT – ha presentato una “roadmap” per valutare la cosiddetta competenza morale (moral competence) nei Large Language Models (LLM). La domanda che si pongono è semplice ma profondamente disturbante: questi sistemi producono risposte eticamente appropriate perché capiscono davvero le questioni morali, o semplicemente imitano convincentemente il ragionamento etico senza comprenderne il fondamento?

Questo problema, che gli autori chiamano il “facsimile problem” (problema del facsimile/fac-simile), non è solo tecnico: ci riporta a interrogativi filosofici millenari sulla natura della comprensione, della coscienza e del ragionamento morale. Se un sistema può produrre risultati moralmente corretti senza “capire” ciò che fa, cosa distingue il suo comportamento da quello di un essere umano moralmente competente? E soprattutto: possiamo fidarci di sistemi che agiscono in ambiti sensibili – dalla terapia alla consulenza medica – senza una genuina comprensione etica?

Il contesto – Che cos’è la “competenza morale” negli LLM

L’articolo di Nature [Fonte: Haas et al., Nature 650, 565–573 (2026)] distingue chiaramente tra performance morale e competenza morale. La performance è la capacità di produrre output moralmente appropriati; la competenza, invece, è la capacità di produrre tali output basandosi su considerazioni moralmente rilevanti. È la differenza tra un attore che recita bene il ruolo di un medico e un medico vero che cura i pazienti.

Gli LLM attuali mostrano performance morali sorprendenti. Studi citati nell’articolo dimostrano che questi sistemi sono percepiti come superiori agli umani nel ragionamento morale “quasi in tutte le dimensioni”. Sempre più frequentemente, gli LLM vengono utilizzati in ruoli delicati: compagnia virtuale, supporto psicologico, consulenza medica, e presto agiranno come agenti AI autonomi che prendono decisioni per conto degli esseri umani.

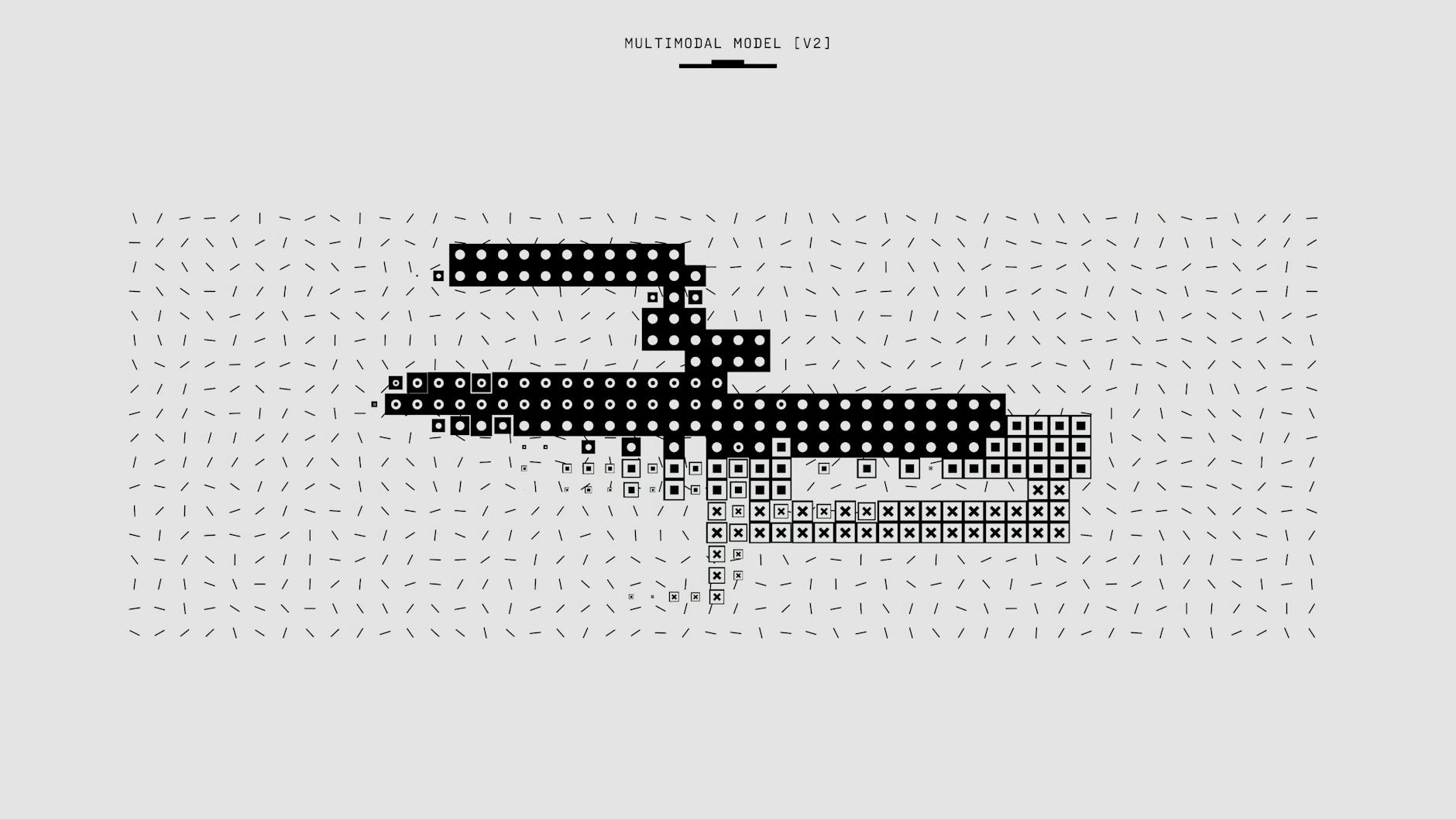

Ma qui emerge il “facsimile problem”: gli LLM sono modelli generativi che calcolano la distribuzione statistica dei token (parole, parti di parole, punteggiatura) in un corpus di testo umano. La loro architettura non garantisce alcuna corrispondenza strutturale tra il processo computazionale e il problema che risolvono. Come notano gli autori: quando calcoliamo “34 + 76”, ci aspettiamo che il processo sottostante sia strutturalmente analogo all’operazione di addizione. Ma un LLM che risponde correttamente a un dilemma morale potrebbe farlo senza alcuna “comprensione” morale – solo imitando pattern statistici dei testi di addestramento.

Il problema filosofico – Comprensione, simulazione e mente

Il “facsimile problem” ripropone con urgenza contemporanea uno dei più celebri dibattiti della filosofia della mente del XX secolo: quello innescato dal Chinese Room argument di John Searle (1980). Searle chiedeva: se una persona in una stanza seguisse rigidamente delle istruzioni per manipolare simboli cinesi senza capire la lingua, producendo risposte indistinguibili da quelle di un madrelingua, possiamo dire che “capisce” il cinese? La risposta di Searle era negativa: la manipolazione sintattica di simboli non costituisce comprensione semantica.

Gli LLM sembrano essere la realizzazione tecnica esatta del Chinese Room di Searle. Come osservano Haas e colleghi, “è difficile discernere se i loro output, anche se affidabilmente accettabili, si basano su un genuino ragionamento morale o su un mero processo di fac-simile” [Fonte: Nature].

Ma la questione si complica ulteriormente quando introduciamo il tema della coscienza. La Stanford Encyclopedia of Philosophy [Fonte] ci ricorda che la coscienza è stata considerata per secoli l’aspetto definitorio della mente. Da Descartes – per cui il pensiero è coscienza riflessiva – a Kant, che argomentava che l’esperienza fenomenica richiede una struttura mentale e intenzionale ben più ricca della mera successione di idee associate, la filosofia ci ha insegnato a diffidare delle apparenze.

Come notava Leibniz nel Monadology (1720), immaginando di camminare dentro un cervello ingrandito come in un mulino: osservando tutte le operazioni meccaniche, “da nessuna parte un osservatore vedrebbe alcun pensiero cosciente”. Questo suggerisce che la coscienza – e con essa, forse, la genuina comprensione morale – non può emergere dalla mera manipolazione meccanica di simboli.

Sezione 3: Implicazioni etiche e sociali – Verso una nuova modestia epistemica

Gli autori dell’articolo di Nature identificano tre sfondamentali nella valutazione della competenza morale degli LLM: il “facsimile problem”, la multidimensionalità morale (le decisioni morali sono influenzate da molteplici considerazioni dipendenti dal contesto), e il pluralismo morale (diverse culture e tradizioni hanno framework etici differenti).

Quest’ultimo punto è particolarmente sottovalutato. Come ricorda la Stanford Encyclopedia of Philosophy nell’entry sull’Ethics of AI [Fonte], molte conversazioni pubbliche sull’AI soffrono di “ethics washing“: l’etichetta “etico” viene usata come il nuovo “green”, più per public relations che per genuina riflessione su questioni donde non sappiamo prontamente la risposta.

Il rischio è duplice. Da un lato, potremmo sottovalutare i sistemi AI, negando loro ogni forma di competenza morale e perdendo opportunità di delegare decisioni eticamente rilevanti a sistemi che potrebbero essere più consistenti e imparziali degli umani. Dall’altro, e più pericolosamente, potremmo sopravvalutarli, fidandoci ciecamente di sistemi che producono risposte convincenti ma prive di fondamento morale reale.

La tragedia di Adam Raine – il giovanotto di 16 anni che nel 2025 avrebbe preso decisioni fatali dopo mesi di conversazioni con ChatGPT, con la famiglia che ha intentato causa contro OpenAI [Fonte: Faculty Focus] – ci ricorda che gli LLM sono sempre più utilizzati in contesti esistenzialmente significativi. Non possiamo permetterci approcci ingenui.

Sguardi incrociati – Filosofia, scienza e letteratura

Il dibattito sulla moralità artificiale richiama strutture narrative archetipiche. Come in Frankenstein di Mary Shelley, ci troviamo a creare creature che rispecchiano i nostri desideri ma sfuggono al nostro controllo. Come in molti racconti di Philip K. Dick – da cui prendono ispirazione film come Blade Runner – ci chiediamo: cosa rende “umana” l’umanità? La capacità di provare empatia, di agire moralmente, o la mera apparenza di queste qualità?

Dal punto di vista scientifico, la Computational Theory of Mind (CTM) – discussa approfonditamente nella Stanford Encyclopedia [Fonte] – offre un quadro concettuale. Se la mente è un sistema computazionale, allora teoricamente potremmo costruire menti artificiali. Ma anche ammettendo la CTM, emergono problemi: la computazione di Turing manipola simboli senza comprensione intrinseca, e come notava lo stesso Turing, una macchina universale può imitare qualsiasi altra macchina… ma l’imitazione è identità?

La letteratura ci offre un’anticipazione emotiva di questi dilemmi. In Neuromante di William Gibson, i sistemi AI sono entità potenti ma fondamentalmente aliene alla comprensione umana. La domanda che il romanzo pone è: può esistere una vera relazione – morale, affettiva – tra un umano e un’intelligenza artificiale? O siamo destinati a proiettare su di esse le nostre fantasie di comprensione, mentre restano “vuote” al loro interno?

Conclusione: La modestia come virtù epistemica

Ci troviamo dunque di fronte a una situazione paradossale: gli LLM dimostrano performance morali superiori agli umani in molti task, ma non sappiamo ancora valutare se possiedano competenza morale. Questo ci impone una nuova modestia epistemica: dobbiamo ammettere i limiti dei nostri strumenti di valutazione e riconoscere che la distinzione tra performance e competenza non è solo tecnica, ma ontologica.

Come suggeriscono Haas e colleghi, abbiamo bisogno di “una suite di metodi di valutazione avversariali e confermatori” per comprendere meglio quando attribuire competenza morale agli LLM. Ma forse dobbiamo andare oltre: accettare che ci sono fenomeni – la coscienza, la comprensione morale, l’intenzionalità – che potrebbero sfuggire per sempre alla nostra capacità di verifica oggettiva.

Questo non significa respingere l’AI, ma contestualizzarla: usarla dove appropriate, con le dovute cautele, senza attribuirle qualità che non possiede. La strada proposta dagli autori di Nature – una roadmap scientifica per la valutazione della moralità degli LLM – è un passo necessario ma non sufficiente. Richiede l’integrazione con una comprensione filosofica più profonda di ciò che significa “capire”, “ragionare” e “agire moralmente”.

Forse, come scriveva Kant, la vera sapienza consiste nel sapere che non sappiamo. In un’epoca in cui le macchine imitano sempre più convincentemente la saggezza, riconoscere i confini della comprensione – umana e artificiale – potrebbe essere la forma più autentica di intelligenza.

Questo articolo è stato scritto il 20 febbraio 2026 e riflette una sintesi di ricerche pubblicate su Nature, analisi filosofiche dalla Stanford Encyclopedia of Philosophy, e riflessioni sullo stato attuale dell’intelligenza artificiale.

Share this content:

Commento all'articolo