L’archivio infinito: intelligenza artificiale e la memoria collettiva del futuro

L’umanità ha sempre avuto una relazione ossessiva con la propria memoria. Dalle tavolette cuneiformi ai server cloud, il bisogno di conservare il sapere attraversa ogni civiltà come un filo conduttore invisibile ma tenace. Oggi, mentre l’intelligenza artificiale promette di trasformare radicalmente il modo in cui produciamo e consumiamo informazioni, ci troviamo di fronte a una domanda filosoficamente inquieta: che cosa significherà preservare la cultura in un’era in cui le macchine possono generare, classificare e interpretare i documenti del passato con una velocità impensabile fino a pochi anni fa?

La conservazione come atto culturale

Quando l’UNESCO stima che circa il 40 per cento delle lingue attualmente parlate rischia di scomparire nel corso del XXI secolo, non si tratta semplicemente di una perdita linguistica. Ogni lingua che muore porta con sé un universo di conoscenze, modi di vedere il mondo, tradizioni di cura della terra, pratiche mediche, narrazioni orali. La ricerca di Vincent Koc pubblicata su arXiv nel gennaio 2025 evidenzia come i modelli linguistici di ultima generazione possano essere addestrati su corpora limitati di lingue in via di estinzione, generando strumenti di scrittura predittiva, correttori ortografici e interfacce di traduzione che amplificano la visibilità di idiomi altrimenti condannati all’oblio.

Ma questo intervento tecnologico solleva interrogativi profondi. La conservazione digitale non è uno scatto fotografico passivo: è un atto interpretativo, una selezione che include ed esclude. Jane Winters, docente di Digital Humanities presso la School of Advanced Study dell’Università di Londra, ha osservato in un recente articolo pubblicato da CLIR come l’intelligenza artificiale sia ormai “essenziale per pulire, esplorare e visualizzare le collezioni speciali e gli archivi, specialmente quelli nativi digitali, che sono vastissimi”. La sfida non è più se utilizzare questi strumenti, ma come governarne l’uso in modo eticamente consapevole.

Dalla pergamena all’algoritmo

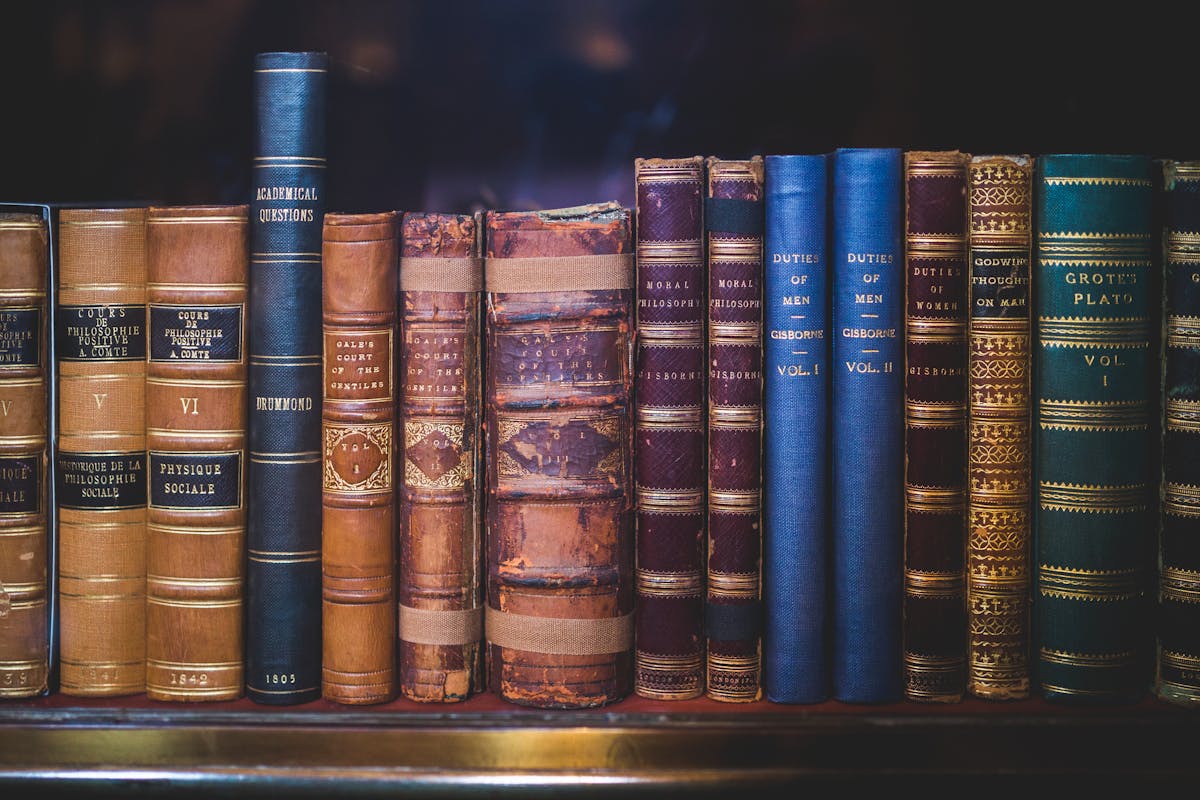

La trasformazione è radicale. Per secoli, la custodia del sapere è stata affidata a istituzioni fisiche — biblioteche, archivi, musei — i cui edifici stessi incarnavano il valore simbolico della conservazione. Oggi le Digital Humanities stanno ridefinendo il concetto stesso di “fonte storica”. Come documenta un’analisi di Agenda Digitale del dicembre 2024, la digitalizzazione massiva ha spostato l’unità base dalla pagina fisica al documento PDF, e ora verso banche dati interconnesse dove il testo viene scomposto, annotato automaticamente e ricomposto in nuove configurazioni semantiche.

Il riconoscimento del testo manoscritto (HTR, Handwritten Text Recognition) si sta rivelando particolarmente trasformativo. Strumenti come Transkribus consentono di addestrare modelli di intelligenza artificiale su script specifici, aprendo l’accesso a collezioni premoderne precedentemente inaccessibili alla ricerca sistematica. Non stiamo più parlando di semplice digitalizzazione: stiamo parlando di un’infrastruttura che permette una “lettura scalabile” delle collezioni, combinando analisi quantitative su larga scala con approcci qualitativi che richiedono ancora l’esperto umano.

La piattaforma Heritage Connector, sviluppata in collaborazione con il Science Museum Group e il Victoria & Albert Museum, ha utilizzato l’intelligenza artificiale per costruire una “rete di connessioni” tra i record delle collezioni, strutturando i dati in un knowledge graph aperto che permette di esplorare il patrimonio culturale in modi prima impossibili. L’archivio diventa così dialogante, capace di rivelare relazioni nascoste tra oggetti distanti nel tempo e nello spazio.

Le lingue che l’AI può salvare

Il progetto Rosetta della Long Now Foundation, lanciato con l’ambizione di documentare e preservare 1.500 lingue in un archivio pubblicamente accessibile, rappresenta forse l’espressione più limpida di questo sforzo. Iniziato prima che l’attuale generazione di modelli linguistici divenisse disponibile, anticipava una tendenza ora affermata: la possibilità di conservare la diversità culturale attraverso l’ingegneria digitale.

Non si tratta solo di raccolta passiva. Esempi concreti stanno emergendo in contesti geografici diversi. Lo sviluppatore nigeriano Gabriel Emmanuel ha creato OBTranslate, una piattaforma dedicata alle circa 2.000 lingue africane, molte delle quali in stato critico di sottoutilizzazione. Google ha collaborato con istituzioni locali per sviluppare moduli di traduzione basati su piattaforme open source come TensorFlow, riducendo i tempi di trascrizione da milioni di ore a frazioni computazionalmente gestibili.

Ma c’è un rovescio della medaglia che non possiamo ignorare. Come evidenzia The Dial in un reportage del novembre 2024, esiste il rischio reale che l’intervento dell’intelligenza artificiale nelle lingue minoritarie si configurhi come una nuova forma di colonialismo digitale. Se i modelli sono addestrati prevalentemente su corpora di grandi dimensioni in inglese, cinese, spagnolo e francese, la “preservazione” rischia di diventare una standardizzazione che schiaccia le specificità locali sotto il peso di formati algoritmici predefiniti. La lingua svan del Georgia occidentale, classificata come “certamente a rischio”, potrebbe sopravvivere in un database, ma a quale prezzo per la sua autentica vitalità culturale?

Archivi invisibili e memorie sommerse

La conservazione algoritmica introduce una nuova categoria di problemi: l’insicurezza dell’oblio. Quando i documenti del passato migrano su supporti digitali, diventano vulnerabili a forme precedenti di perdita. I formati si deteriorano, i software diventano obsoleti, i metadati si corrompono. L’intelligenza artificiale viene oggi impiegata anche per invertire questo flusso: restaurare documenti danneggiati, ricostruire testi lacunosi, identificare pattern di degrado nelle immagini prima che diventino irreversibili.

Ma c’è un archivio più vasto e inquietante: quello dei “non ancora dimenticati”, i contenitori culturali che esistono nelle zone di confine tra digitale e analogico, tra vivo e registrato. Le case si svuotano, le cantine vengono ripulite, le cassette vengono gettate senza che nessuno abbia verificato il loro contenuto. L’intelligenza artificiale potrebbe aiutare a setacciare queste montagne di materiale, ma richiede una decisione politica: investire risorse nella memoria collettiva significa riconoscere che il passato è una forma di capitale pubblico, non un optional culturale.

La Regione Emilia-Romagna ha recentemente stanziato 15 milioni di euro per 76 progetti di digitalizzazione del patrimonio culturale, dalle carte di don Milani alla ricostruzione di siti archeologici. Questo tipo di investimento rappresenta un riconoscimento che la conservazione è un atto civico, non una curiosità antiquaria. Le tecnologie di intelligenza artificiale sono chiamate a rendere “il patrimonio culturale dei territori sempre più vicino e accessibile a tutti”, come ha dichiarato l’assessora regionale alla cultura Gessica Allegni.

Verso una biblioteca del tempo lungo

Forse il contributo più significativo dell’intelligenza artificiale alla conservazione culturale risiede nella sua capacità di cambiare la nostra percezione temporale. La Long Now Foundation promuove un “pensiero a lungo termine” — quello della civiltà, dei prossimi e degli ultimi diecimila anni. In questa prospettiva, l’archivio diventa qualcosa di più che un deposito del passato: è un ponte verso il futuro, un atto di fiducia nelle generazioni che verranno.

L’intelligenza artificiale ci offre strumenti per immaginare come potrebbero essere queste biblioteche del futuro. Non semplicemente depositi passivi, ma sistemi attivi di cura della memoria, capaci di apprendere dalle interazioni degli utenti, di suggerire connession

Share this content:

Commento all'articolo