Bit e significato: la sfida semantica nell’era dell’intelligenza artificiale

Quando nel 1948 Claude Shannon pubblicò l’articolo che avrebbe fondato la teoria matematica della comunicazione, probabilmente non immaginava che la sua intuizione sul bit avrebbe attraversato ogni ambito del sapere umano. Quella stessa unità di misura che permette di quantificare l’informazione trasmessa attraverso un canale si è rivelata tanto potente da diventare il linguaggio universale dell’era digitale. Eppure, settant’anni dopo, un interrogativo rimane aperto: la teoria dell’informazione riesce davvero a cogliere ciò che chiamiamo “significato”?

La domanda non è meramente accademica. Negli ultimi anni, i modelli di linguaggio di grandi dimensioni hanno dimostrato capacità sorprendenti nella generazione di testi coerenti, traduzioni fluide e persino ragionamenti apparentemente sofisticati. Eppure, come hanno argomentato Emily Bender e Alexander Koller in un influente articolo del 2020, questi sistemi “addestrati unicamente sulla forma non hanno a priori alcun modo di apprendere il significato”. La distinzione tra sintassi e semantica, che i filosofi del linguaggio coltivano da decenni, torna così al centro del dibattito sull’intelligenza artificiale.

La rivoluzione di Shannon e i suoi confini

Per comprendere la portata della questione, è necessario tornare alle origini. Claude Shannon, matematico e ingegnere statunitense, definì l’informazione come qualcosa di distinto dalla materia e dall’energia — un’entità matematica misurabile attraverso la sorpresa statistica associata a un evento. Il bit, contrazione di “binary digit”, divenne l’atomo dell’informazione digitale, permettendo di calcolare l’entropia di una sorgente e la capacità di un canale di trasmissione.

Questa formalizzazione ebbe conseguenze rivoluzionarie. Permise di ottimizzare le comunicazioni telefoniche, fondò la teoria della codifica e rese possibile l’era dei computer. Al tempo stesso, come notò lo stesso Shannon, la sua teoria era deliberatamente priva di considerazioni semantiche: si occupava della trasmissione efficiente dei messaggi, non della loro interpretazione. Il significato, nella definizione shannoniana, era un concetto irrilevante per la progettazione degli ingegneri.

Questa scelta metodologica, lungi dall’essere un limite, consentì progressi straordinari. Ma quando si applica la stessa impostazione all’intelligenza artificiale — trattando il linguaggio come pura sequenza di simboli da predire — si apre una sfida concettuale di portata filosofica. Se un sistema apprende esclusivamente correlazioni statistiche tra forme linguistiche, può mai raggiungere una comprensione genuina del contenuto?

La trappola della forma: apprendimento senza intenzione

L’argomento di Bender e Koller si articola con precisione rigorosa. I modelli di linguaggio, per quanto sofisticati, vengono addestrati su corpora di testo che contengono esclusivamente forme — sequenze di caratteri, parole, costruzioni sintattiche. L’addestramento consiste nell’ottimizzare la probabilità di predire l’elemento successivo in una sequenza. Non c’è accesso a intenzioni comunicative, a stati mentali, a riferimenti del mondo.

Questo non significa che i modelli non producano output utili o sorprendenti. Significa piuttosto che la loro prestazione può essere descritta completamente in termini di manipolazione simbolica — esattamente ciò che John Searle aveva in mente con il celebre esperimento della stanza cinese. Il sistema elabora simboli secondo regole formali senza che vi sia una comprensione del loro significato.

L’analogia proposta da Bender e Koller è illuminante: un modello di linguaggio addestrato su codice sorgente può diventare straordinariamente abile nel generare programmi sintatticamente corretti, ma non ha accesso all’esecuzione dei programmi, all’input e all’output, alla semantica operazionale del linguaggio. Allo stesso modo, un sistema addestrato esclusivamente su testi non ha accesso alle situazioni che quei testi descrivono, alle intenzioni degli speaker, alla verità delle proposizioni.

Semantica intenzionale e sistemi linguistici

La questione sollevata non riguarda soltanto l’ingegneria dei sistemi informatici, ma investe la filosofia del linguaggio in modo profondo. Cosa significa “intendere” un’espressione linguistica? Secondo la teoria teleosemantica di Ruth Millikan, il significato emerge dalle funzioni biologiche degli organismi che usano i segni. Secondo l’approccio di Gareth Evans, il riferimento è determinato da pratiche di denominazione collettive.

Entrambe le prospettive richiedono un ancoraggio al mondo — che si tratti di funzioni selettive evolutivamente o di pratiche sociali condivise. E qui risiede il nodo del problema: i modelli di linguaggio attuali mancano di entrambi gli ancoraggi. Non sono organismi con storia evolutiva, né partecipano a pratiche sociali nel senso pieno del termine. La loro intenzionalità, se così la si vuole chiamare, è derivata e secondaria rispetto a quella dei parlanti umani.

Questo non implica necessariamente che i sistemi siano privi di significato. Un recente articolo su Synthese ha argomentato che la dipendenza da sistemi linguistici preesistenti caratterizza anche l’intenzionalità umana, sebbene in modo diverso. Il punto cruciale è che il significato nel suo senso pieno richiede una relazione triadica — tra simbolo, interprete e mondo — che va oltre la pura correlazione statistica.

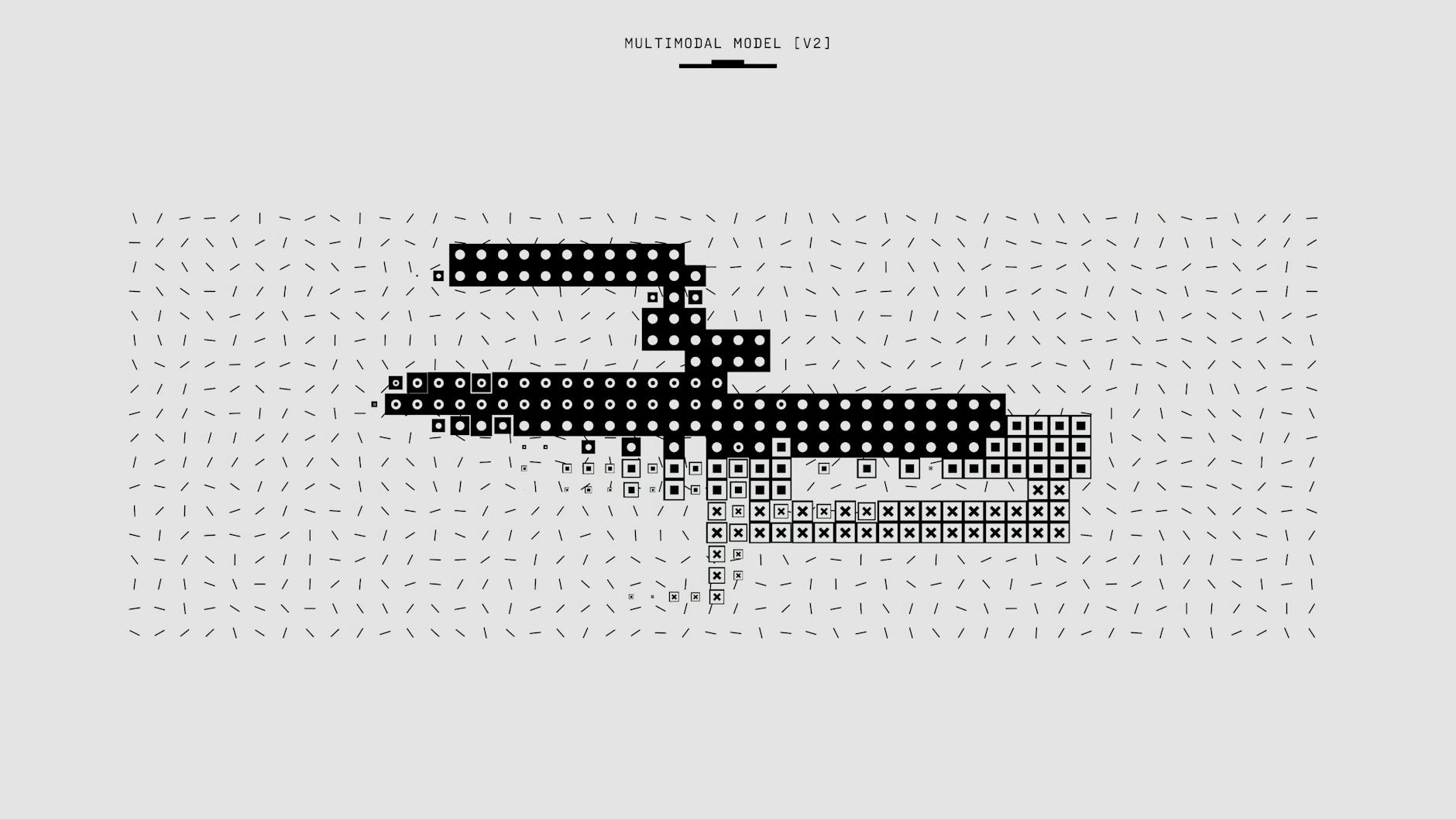

La comunicazione semantica: nuove frontiere teoriche

Il dibattito ha stimolato ricerche innovative nel campo della comunicazione semantica. Diversamente dalla teoria classica dell’informazione, la comunicazione semantica non si occupa della trasmissione fedele di sequenze di bit, ma dell’efficacia nel trasferire significato. La domanda diventa: quanta informazione è necessaria perché un ricevente raggiunga una comprensione equivalente a quella del mittente?

Questo approccio inverte la prospettiva. Invece di chiedere “quanti bit servono per codificare questo messaggio?”, si chiede “qual è la quantità minima di informazione necessaria per ottenere questo effetto pragmatico?”. La distinzione è fondamentale: il primo approccio è puramente sintattico, il secondo è semanticamente orientato.

Le applicazioni pratiche sono considerevoli. Nelle reti di nuova generazione, la comunicazione semantica promette di ridurre drasticamente i requisiti di banda per compiti specifici, concentrandosi sul significato rilevante piuttosto che sulla riproduzione esatta. Ma i fondamenti teorici rimangono controversi: che cosa significa esattamente trasmettere significato?

L’orizzonte della comprensione

La questione sintassi-semantica assume contorni particolarmente netti quando si considerano le attuali discussioni sull’intelligenza artificiale generale. Se la capacità di manipolare simboli in modo statisticamente plausibile non basta per garantire la comprensione, quali requisiti aggiuntivi sarebbero necessari?

Alcuni ricercatori propongono l’incorporamento — l’interazione sensorimotoria con il mondo fisico — come condizione necessaria. Altri insistono sulla necessità di intenzionalità originaria, non derivata. Altri ancora suggeriscono che la comprensione richieda una forma di coscienza o di esperienza soggettiva, spostando il problema sul terreno della filosofia della mente.

Quel che sembra emergere con chiarezza è che la distinzione tra performance e competenza — tra comportarsi come se si capisse e capire davvero — non è meramente filosofica, ma ha conseguenze concrete per la progettazione dei sistemi. Se esistono compiti per cui la manipolazione sintattica è sufficiente, ve ne sono altri per cui richiederebbe la comprensione semantica genuina.

Conclusione

La teoria dell’informazione di Shannon ha fornito gli strumenti matematici che resero possibile l’era digitale. Eppure, come dimostra il dibattito contemporaneo, quegli stessi strumenti mostrano i loro limiti quando si cerca di catturare ciò che rende il linguaggio un fenomeno significativo. La pura quantificazione dei bit non basta a spiegare come i simboli acquistano senso, come rinviano al mondo, come diventano veicoli di pensiero.

I modelli di linguaggio attuali rappresentano un’impresa tecnica straordinaria, ma il loro funzionamento solleva interrogativi che attraversano la filosofia del linguaggio, la filosofia della mente e l’epistemologia. Possiamo costruire sistemi sempre più abili nel manipolare simboli senza mai attraversare la soglia che separa la sintassi dalla semantica? O esiste un percorso — attraverso l’incorporamento, l’interazione sociale, forse forme di esperienza ancora da concepire — che permetta ai sistemi artificiali di trascendere la loro natura di puri manipolatori di forma?

La questione non è se questi sistemi siano “intelligenti” secondo qualche metrica arbitraria, ma piuttosto che tipo di rapporto instaurano con il linguaggio, con il mondo, con noi. E forse, nel cercare di rispondere, scopriremo tanto sull’intelligenza artificiale quanto sulla natura del nostro proprio intendere.

Share this content:

Commento all'articolo